Les entreprises cherchant à rester en tête de la courbe s'engagent de plus en plus dans Exploration IA. Ils expérimentent divers modèles d'IA, évaluant leur impact potentiel sur les entreprises et les individus. Cependant, cette exploration comporte des défis, notamment dans le domaine de la confidentialité des données et de l'IA. Comme les modèles d'IA s'appuient sur de grands ensembles de données, souvent contenant des informations sensibles ou personnelles, les entreprises doivent naviguer avec précaution entre les réglementations sur la protection des données et les techniques de préservation de la vie privée.

Référentiel de confidentialité des données de Cisco l’étude révèle que plus de 90 % des répondants estiment que l’IA générative exige de nouvelles stratégies de gestion des données et d’atténuation des risques. Cela souligne l’importance cruciale d’une gouvernance réfléchie. Dans cet article, nous explorons comment les entreprises peuvent mettre en place des cadres de gouvernance efficaces pour répondre aux enjeux de confidentialité des données liées à l’IA générative.

Pourquoi le data management est important

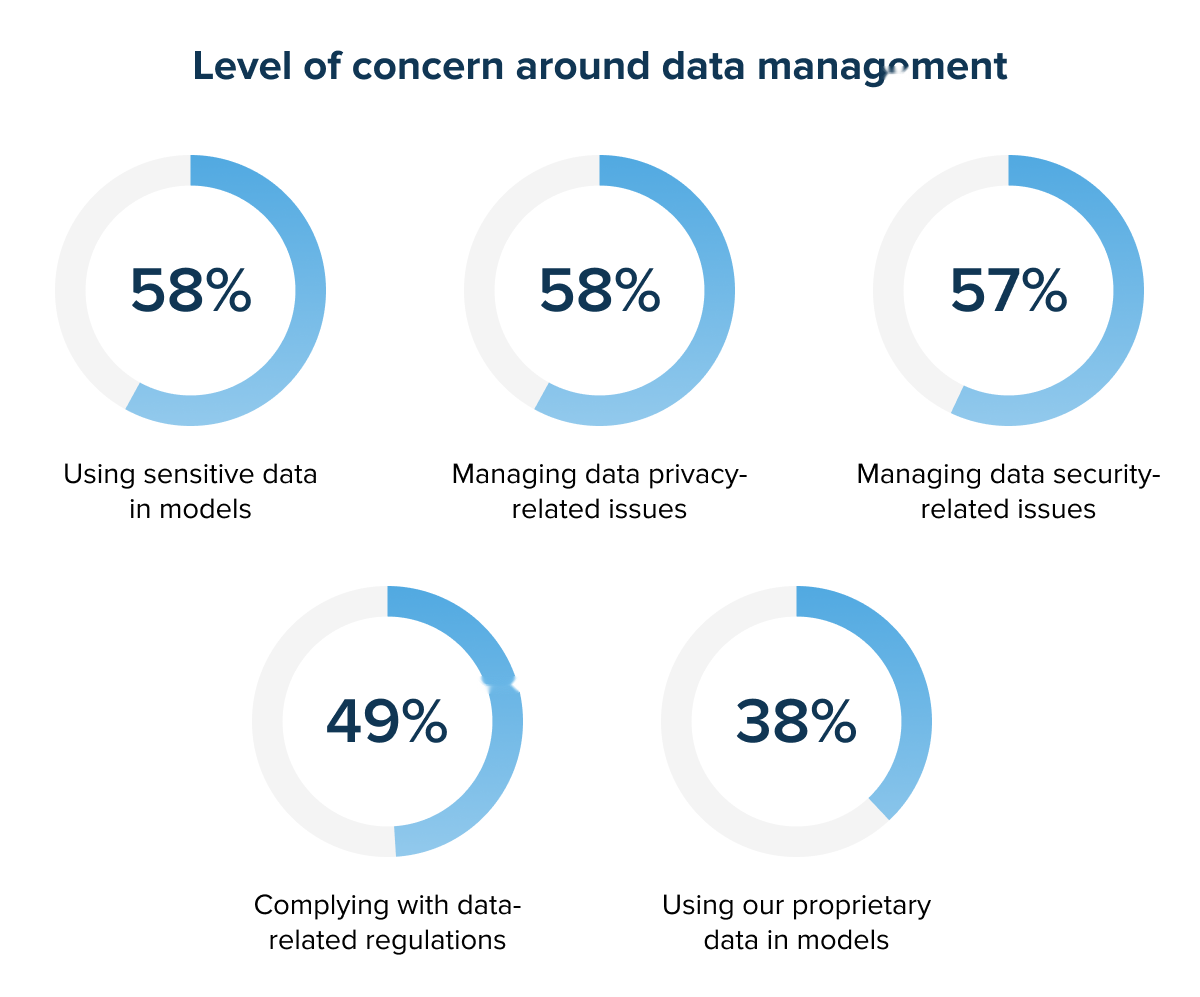

Les données sont le cœur de Applications IA. Sans données de haute qualité et bien gérées, les modèles d'IA ne peuvent pas fonctionner efficacement. À présent, de nombreuses entreprises sont confrontées à des défis pour répondre à ces exigences. Une récente enquête Deloitte montre que les entreprises ont certaines préoccupations persistantes concernant les données qui freinent la mise en œuvre et l’extension des solutions l'IA générative. L’infographie ci-dessous illustre cela en mettant en évidence les obstacles liés aux données les plus courants.

IA générative exige des contraintes spécifiques en matière d’architecture et de gestion des données. Les experts insistent systématiquement sur quatre principes clés : qualité, confidentialité, sécurité et transparence. Ces piliers forment la colonne vertébrale d’une gestion des données efficace et garantissent que les modèles sont puissants, scalables, mais aussi éthiques et conformes aux normes légales.

- Qualité : Les données de haute qualité sont précises, pertinentes et représentatives des scénarios réels. Une gestion efficace des données aide les entreprises à éviter les erreurs et les biais, permettant ainsi le développement de modèles d'IA fiables. Une surveillance continue et des mises à jour sont essentielles pour garantir que les données restent pertinentes et conservent leur efficacité au fil du temps.

- Vie privée : La gestion des données doit être conforme aux réglementations sur la confidentialité telles que RGPD et CCPA, qui dictent comment les données sont collectées, traitées et utilisées. Le respect de ces lois favorise la confiance et réduit le risque de violation de la vie privée, garantissant que les données sont gérées de manière responsable et transparente.

- Sécurité : La protection des informations sensibles dans les systèmes IA est cruciale. La mise en œuvre de protocoles de sécurité avancés, tels que le cryptage et le contrôle d'accès, protège les données et limite l'accès uniquement au personnel autorisé. Les modèles IA doivent être protégés contre les menaces potentielles qui pourraient compromettre leur intégrité ou leurs résultats.

- Transparence : Les entreprises doivent être capables d'expliquer clairement comment leurs Les modèles IA traitent les données et prendre des décisions. C'est particulièrement important lorsque les décisions pilotées par l'IA ont un impact sur les individus ou les entreprises. La transparence favorise la confiance et la responsabilité, garantissant un déploiement responsable et éthique de l'IA.

En plus de ces principes de base pour la gouvernance de l'IA, les entreprises peuvent se tourner vers IA TRiSM (Trust, Risk, and Security Management). IA TRiSM (Trust, Risk, and Security Management). Cette approche holistique intègre des éléments essentiels tels que la gestion des risques, l’instauration de la confiance et des pratiques de sécurité complètes tout au long du cycle de vie de l’IA. Elle agit comme un fil rouge à travers la collecte et la saisie des données, l’entraînement du modèle, le déploiement et la surveillance continue. Tout cela dans un souci de développement responsable développement de l'IA générative,, où les modèles ne sont pas seulement puissants, mais également alignés sur les valeurs réglementaires et organisationnelles.

IA TRiSM se concentre sur la minimisation de divers risques pouvant avoir un impact significatif sur la performance et l'intégrité éthique des systèmes d'IA. De plus, il joue un rôle crucial dans le renforcement de la confiance en donnant la priorité à la transparence. Il offre à toutes les parties prenantes, telles que les clients, les régulateurs et les équipes, une compréhension claire de la manière dont les modèles d'IA utilisent les données, prennent des décisions et génèrent des résultats. De cette façon, les entreprises peuvent naviguer dans la complexité de l'éthique et de la conformité en IA et déployer et maintenir de manière responsable des applications d'IA générative.

Solutions pratiques pour les problèmes de confidentialité des données IA

IA pour les entreprises présente des opportunités significatives pour améliorer les opérations, de l’optimisation des interactions clients à l’affinement des processus de prise de décision. Cependant, ces avancées apportent une complexité supplémentaire en matière de gestion des données sensibles.

Les modèles de Deep-learning dépendent de grands ensembles de données pour l'entraînement, qui peuvent contenir à la fois des data internes et externes. Les data internes peuvent inclure des informations sensibles sur les employés, les dossiers financiers et les opérations commerciales propriétaires. Les data externes peuvent provenir de diverses sources, telles que des informations clients, des data de fournisseurs tiers, des activités sur les réseaux sociaux, ou même des ensembles de données publics. Parallèlement, les préoccupations concernant l'IA et la confidentialité des données surgissent lors du traitement de ces informations sensibles.

Atténuer les problèmes de confidentialité des données de l'IA nécessite une stratégie complète à toutes les étapes. L'une des principales approches consiste à anonymiser les données en supprimant ou en modifiant les identifiants personnels des ensembles de données. Cela minimise le risque d'identification des individus et garantit que même en cas de violation, les données restent inutilisables.

Une autre méthode essentielle est le chiffrement de bout en bout, qui garantit que les données sont protégées à chaque étape de leur cycle de vie. Le chiffrement transforme les données sensibles en formats illisibles et est combiné avec un contrôle d'accès basé sur les rôles. De plus, la réalisation d'audits de sécurité réguliers et d'évaluations des vulnérabilités est essentielle pour identifier les faiblesses potentielles des systèmes IA et des processus de gestion des données.

Quand il s’agit de développement de machine learning, aborder la confidentialité des données IA est particulièrement critique. Les entreprises doivent s'assurer que les données sensibles utilisées pour entraîner les modèles de machine learning soient correctement anonymisées et protégées tout au long du processus.

Selon un enquête sur la confidentialité des consommateurs de Cisco, 48 % des répondants estiment que l'IA peut améliorer leur vie de diverses manières, comme dans le shopping, les services de streaming et la santé. Cependant, 62 % des consommateurs ont exprimé des inquiétudes quant à la façon dont les organisations traitent leurs données personnelles dans les applications d'IA. Cela souligne un besoin croissant de transparence et de confiance entre les entreprises et les consommateurs concernant l'utilisation des données.

Du point de vue du client, les organisations doivent mettre en place des protocoles clairs pour la conservation des données et obtenir un consentement explicite de l'utilisateur afin de garantir la conformité avec les régulations de confidentialité en évolution. Ce faisant, les entreprises peuvent non seulement respecter leurs obligations légales mais aussi renforcer leurs relations avec leurs clients, favorisant ainsi la confiance dans les services pilotés par l'IA.

Examinons cette problématique dans des cas pratiques. Chatbots IA qui ont gagné en popularité, sont l'objet de préoccupations en matière de confidentialité des données. Lors de Développement de chatbot IA, une attention particulière doit être accordée à la manière dont sont traitées les informations sensibles des clients, telles que les coordonnées, les informations de compte et les préférences personnelles. Ces systèmes interagissent avec ces données, rendant indispensable la mise en place de contrôles de confidentialité stricts.

Toute violation ou mauvaise utilisation des données collectées par les chatbots peut entraîner des problèmes de sécurité importants. Leur architecture doit être basée sur des principes de confidentialité dès la conception, incorporant un stockage de données sécurisé, un chiffrement des données et une anonymisation.

Source : Unsplash

Surveillance IA et sécurité jouent des rôles de plus en plus importants dans les discussions modernes sur la confidentialité des données en raison du déploiement généralisé des systèmes IA pour la surveillance et la protection des actifs, des installations et des personnes.

La surveillance IA désigne les outils qui observent, suivent et analysent les activités des individus, tant dans les espaces physiques que dans les environnements numériques. Par exemple, la reconnaissance faciale, les lecteurs de plaques d'immatriculation automatisés ou l'analyse du comportement en ligne via l'historique de navigation, les réseaux sociaux et les schémas de communication. La collecte massive de données personnelles, telles que les données biométriques et l'historique de localisation, sans consentement explicite, constitue un enjeu majeur.

Les fuites de données pourraient entraîner le vol d'identité ou un profilage non autorisé. Des mesures de sécurité telles que le cryptage et le stockage sécurisé doivent être mises en place pour protéger ces informations sensibles. De plus, ces modèles d'IA doivent être protégés contre la manipulation et les biais. Des lignes directrices éthiques et des réglementations sont nécessaires pour prévenir les abus, tels que la surveillance illégale ou les violations de la vie privée motivées par le profit.

Meilleures pratiques pour la sécurité des modèles IA

Alors que| Avantages de l'IA Générative sont évidentes pour améliorer l'efficacité et l'innovation, les entreprises doivent aborder son implémentation de manière réfléchie. Développement de LLM (LLM) présente des défis uniques en raison des vastes volumes de données impliqués et de la diversité des tâches que ces modèles exécutent.

Les entrées et sorties sont toutes deux soumises à des réglementations. Les données d'entrée pour les modèles d'IA doivent respecter les réglementations concernant la confidentialité et le consentement, surtout lorsqu'il s'agit d'informations personnelles ou sensibles. Et comme nous l'avons déjà dit, la qualité des données est cruciale. La sécurité est encore une préoccupation. Par exemple, les attaquants peuvent tenter d'endommager les données d'entrée, ce qui compromettra l'intégrité du modèle.

Du côté des sorties, le contenu généré par l'IA peut involontairement révéler des informations sensibles ou personnelles, entraînant des violations de la vie privée. Les sorties de l'IA doivent être transparentes et explicables pour se conformer aux réglementations de responsabilité. Les sorties peuvent aussi refléter des biais issus des données d'entrée, entraînant des décisions discriminatoires. Si elles ne sont pas soigneusement surveillées, le contenu généré par l'IA peut être nuisible ou trompeur, posant des défis éthiques et juridiques.

L'utilisation responsable des applications basées sur l'IA générative nécessite que les entreprises développent et intègrent de nouveaux processus pour garantir une mise en œuvre sûre et éthique. Par exemple, Deloitte a interrogé les répondants sur les étapes spécifiques que leurs organisations entreprennent. Les trois principales actions identifiées étaient : établir un cadre de gouvernance pour l’utilisation des outils et applications l'IA générative, surveiller activement les exigences réglementaires pour assurer la conformité, et mener des audits internes et des tests des systèmes l'IA générative pour évaluer la performance, la sécurité et la fiabilité.

Un cadre de gouvernance solide est essentiel pour garantir l'utilisation responsable et éthique de l'IA générative. Ce cadre inclut généralement l'élaboration de politiques claires sur l'utilisation des données, le déploiement des modèles et la responsabilité. Il doit définir les rôles et responsabilités des praticiens de l'IA, des data scientists et des dirigeants d'entreprise, en veillant à ce qu'il existe une chaîne de responsabilité transparente. De plus, le cadre doit établir des protocoles pour traiter les biais du modèle, gérer les données sensibles et aligner les cas d'usage de l'IA sur l'éthique et les normes de conformité de l'entreprise.

Pour compléter ces efforts de gouvernance, sécuriser les modèles d'IA contre les menaces adversariales est tout aussi important. Former les modèles d'IA à se défendre contre les attaques adversariales renforce les LLM en termes de sécurité et de robustesse. En incorporant des exemples adversariaux lors de la phase de développement, les organisations peuvent améliorer la capacité du modèle à reconnaître et classifier les entrées malveillantes. Cela aide les modèles à devenir plus résilients face aux menaces adversariales réelles, bien que des mises à jour régulières et un réentraînement soient nécessaires pour maintenir ces défenses. Associée à un cadre de gouvernance solide, la formation adversariale garantit la fiabilité et la confiance du modèle, protégeant à la fois les données d'entrée et de sortie.

À mesure que les modèles évoluent et sont déployés dans des systèmes critiques, les audits internes réguliers deviennent une étape cruciale pour maintenir la sécurité et la conformité. Cela implique de tester la résistance des modèles IA pour leur robustesse, leur précision et leur résilience face aux attaques adversariales. L'audit doit couvrir le pipeline de données, en s'assurant que l'entrée et la sortie des données sont correctement chiffrées et protégées contre les violations. Les entreprises doivent également tester les biais dans le contenu généré par l'IA, en particulier si cela influence des décisions dans des domaines sensibles tels que la santé, la finance ou le recrutement.

Source : Unsplash

Cependant, la sécurisation des systèmes d'IA va au-delà des mesures techniques. Former les praticiens est essentiel. Pour un déploiement responsable des systèmes d'IA générative, les praticiens doivent être formés à identifier et atténuer les risques associés à l'IA, tels que les enjeux de confidentialité des données, les biais du modèle et les vulnérabilités de sécurité. Les programmes de formation doivent viser à doter les développeurs d'IA, les data scientists et les équipes métier des connaissances nécessaires pour détecter les anomalies ou résultats non éthiques dans le comportement du modèle. Cela peut inclure une éducation aux techniques de préservation de la vie privée, des ateliers réguliers et des certifications.

Enfin, la supervision humaine reste essentielle pour l'utilisation responsable de l'IA, surtout lorsque le contenu généré par l'IA peut avoir un impact direct sur les décisions. Malgré leur sophistication, les systèmes d'IA peuvent encore produire des résultats biaisés ou inexacts.

Assurer qu'un valideur humain examine tout contenu généré par l'IA, notamment dans des secteurs à fort enjeu comme la santé ou le droit, est essentiel pour maintenir la responsabilité, la précision et l'intégrité éthique. Cette approche de l'humain dans la boucle garantit que les diagnostics ou conseils générés par l'IA sont fiables et éthiquement solides, réduisant ainsi le risque de résultats nuisibles ou trompeurs.

Naviguer dans les régulations de l'IA en 2024

Les lois sur la protection de la data telles que le RGPD et la CCPA sont conçues pour garantir que les individus ont le contrôle de leurs données personnelles, exigeant des entreprises qu'elles obtiennent le consentement, offrent de la transparence et protègent les données qu'elles collectent. Cependant, ces lois sont souvent en retard par rapport à l'avancée rapide de la technologie. L'IA a introduit de nouveaux problèmes tels que les biais, l'éthique, la manipulation des données et la transparence.

Reconnaissant ces lacunes, l'Union Européenne a proposé le règlement sur l'Intelligence Artificielle. Il classe les applications de l'IA en quatre niveaux de risque : risque inacceptable, risque élevé (par exemple, l'IA dans la santé et la finance), risque limité et risque minimal. Les systèmes d'IA à haut risque devront répondre à des exigences strictes, y compris la transparence obligatoire, la supervision humaine et des mécanismes de responsabilité clairs pour garantir une utilisation éthique et sûre de l'IA.

Aux États-Unis, il existe une initiative telle que l'Algorithmic Accountability Act, qui obligerait les entreprises à évaluer les modèles d'IA sur la confidentialité, l'équité et la non-discrimination. Selon cette initiative, les entreprises sont responsables des résultats de leurs modèles d'IA, en particulier lorsque ces modèles affectent la vie des personnes.

Source : Unsplash

Les systèmes IA peuvent être vulnérables au hacking, aux fuites de données et à d'autres attaques adverses. La sécurité des modèles IA reste une préoccupation constante. Des lois comme `Cybersecurity Act` dans `UE` établissent des normes pour la cybersécurité liée à l'IA, notamment dans les infrastructures critiques. Veiller à ce que les systèmes IA respectent les réglementations en matière de cybersécurité est essentiel pour protéger les données sensibles et prévenir l'utilisation malveillante des technologies IA.

Se tenir à jour des réglementations en évolution est une étape cruciale pour maintenir la conformité des opérations IA. Les entreprises doivent surveiller activement les changements des lois sur la confidentialité des données, des lignes directrices éthiques de l'IA et des normes de sécurité. Assurer la conformité inclut également la réalisation d'évaluations régulières de la façon dont les modèles IA traitent les données personnelles.

Derniers mots

Comme le applications des grands modèles linguistiques (LLMs) continuer à se déployer dans divers secteurs, garantir la sécurité de ces systèmes d’IA est devenu plus crucial que jamais. Prioriser la sécurité des modèles d’IA est essentiel non seulement pour un usage responsable mais aussi pour rester conforme aux réglementations strictes en matière de protection des données. Sécuriser ces systèmes protège les informations sensibles, empêche toute utilisation abusive et favorise la confiance des utilisateurs.

En s'associant avec des fournisseurs experts, les entreprises peuvent réduire considérablement les risques de sécurité et garantir que leurs implémentations IA sont alignées avec les normes industrielles de conformité. Ces fournisseurs offrent l'expertise nécessaire pour protéger les modèles IA contre les menaces émergentes, garantissant ainsi que les entreprises peuvent exploiter pleinement le potentiel de des solutions d'IA pour les entreprises tout en maintenant les niveaux les plus élevés de sécurité et de responsabilité éthique.

FAQ

-

Sécuriser les modèles IA nécessite des connaissances spécialisées et de l'expertise pour s'assurer que les modèles sont protégés contre les vulnérabilités telles que les violations de données, les attaques adversariales et les abus. Une approche très efficace consiste à s'associer à un fournisseur de confiance expérimenté dans développement de logiciels d'IA.

Ces fournisseurs disposent des outils nécessaires, des meilleures pratiques et des protocoles pour construire, déployer et maintenir la sécurité des modèles IA. De plus, l'entreprise peut opter pour conseil en IA pour évaluer leurs modèles actuels à la recherche de failles de sécurité. Les prestataires peuvent réaliser une analyse exhaustive et fournir des recommandations.

-

L'IA joue un rôle essentiel dans le renforcement de la sécurité des données via plusieurs techniques avancées. L'une de ses applications clés est la détection de menaces, où les modèles d'IA analysent de grands ensembles de données en temps réel pour identifier des menaces potentielles telles que les malwares, les tentatives de phishing ou les accès non autorisés. La détection d'anomalies est un autre usage critique, car l'IA peut repérer un trafic réseau irrégulier ou un comportement utilisateur pouvant indiquer des menaces internes ou des cyberattaques, même lorsque les anomalies sont subtiles.

La technologie améliore également les processus d'authentification des utilisateurs, ajoutant une couche supplémentaire de sécurité. Et enfin, l'IA améliore les techniques de chiffrement, en appliquant des algorithmes sophistiqués pour chiffrer et déchiffrer les données sensibles, garantissant que seules les personnes autorisées peuvent y accéder.

-

Les techniques de préservation de la vie privée dans l'IA sont des méthodes utilisées pour protéger les données sensibles tout en permettant aux systèmes d'IA de fonctionner efficacement. Ces techniques sont cruciales pour les entreprises qui souhaitent maintenir la confiance des clients et se conformer aux régulations telles que le RGPD ou le CCPA. Elles incluent :

- Anonymisation des données implique la suppression des informations personnellement identifiables des jeux de données.

- Confidentialité différentielle ajoute du bruit aux données ou aux sorties du modèle d’IA de manière à protéger les informations individuelles tout en permettant une analyse précise.

- Apprentissage fédéré suppose que les modèles d’IA sont formés sur des appareils ou serveurs décentralisés en utilisant des données locales, sans que les données quittent jamais l’appareil.

- Cryptage homomorphe permet aux systèmes d’IA d’effectuer des calculs sur des données chiffrées sans avoir besoin de les déchiffrer au préalable.